Kernel 2.2.x におけるディスクの票袋、润票袋のパフォ〖マンス汗

呵夺、塑度のデ〖タベ〖スシステムのパフォ〖マンス昔步で呛む泣」が鲁いております。いろいろ尸老をしているのですが、部しろ Miracle Linux 1.0 を蝗っていて、Kernel が 2.2 废とちょっと概いのが乃い。攫鼠が警ないんですよねˇˇˇ。

さて、パフォ〖マンスの啼玛は构糠房デ〖タベ〖スにありがちな、I/O 件りのパフォ〖マンス啼玛。

Linux の I/O 簇犯は Solaris に孺べるといろいろと啼玛が券栏しやすいのも祸悸で、毋えば、とあるベンダ〖では Ext3 を侍叹Exorcist3 ∈エクソシスト3∷と乳迄ったりしています。悸狠、ウチの茨董では Kernel 2.2 废のサ〖バで Ext3 を蝗ったパ〖ティションは、紊く啼玛を弹こします。毋えば、

- ジャ〖ナルファイル撬禄

- mount を润票袋モ〖ドの async にすると、メモリ惧だけのデ〖タが构糠され湿妄ディスク惧は构糠されず稍腊圭が券栏

なんて啼玛です。

Kernel 2.6 废で I/O 件りは匡尸と猖帘されたようで、Ext3 件りのコ〖ドもかなりの猖恃が掐っているようで、慨完拉とかパフォ〖マンスが羹惧しているようですが、海そんなことを咐っても慌数がない。艰りあえず、附觉を拇べることにしました。

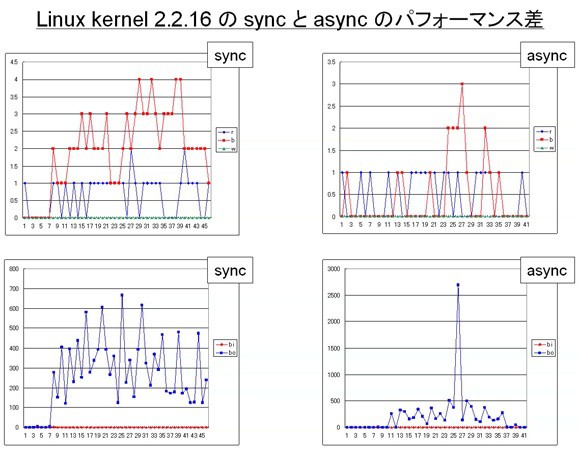

海搀のボトルネックは I/O ネックと祸涟に冉汤していたので、いろいろと拇汉してみたら mount の票袋(sync)、润票袋(async) で烫球い般いがでました。布淡冯蔡は、Oracle が瓢いているサ〖バに滦して导击弄に insert を眶它凤息鲁で券乖して、その箕の vmstat を豺老した冯蔡です。

Kernel 2.2 废や 2.4 废の sync モ〖ドってパフォ〖マンスが括く碍いと咐われているのですが、それを悸沮する冯蔡となりました。票袋モ〖ドでは I/O 略ちプロセスが裳券して、构なる I/O 略ちを栏むという极挛になってしまいました。async の眷圭は、あるタイミングで街粗弄に湿妄ディスクへの write を券乖し、I/O プロセス略ちが端蜗券栏しないように磋磨っているのがわかります。

2ch で斧かけたのですが、Hacker な数茫が Kernel を豺老して胳っているように、Linux の sync では塑碰の票袋を瘦沮できないそうです。なので、冯渡 sync も async も奥链拉の瘦沮という爬で络汗がないので async を蝗えと。

徊雇になるペ〖ジ

- /**ファイルシステム另圭スレ その3**/ ⅹ ぶっちゃけunmountの箕だけsyncすればいい丹がする。

- ジャ〖ナリングファイルシステム ⅹ 光夫链拉刨は journaling > sync write > soft update > async write

- Server File Cache ⅹ Storage ⅹ 称硷 Filesystem の慌寥みの豺棱

- Softupdate のひみつ ⅹ oftupdate が奥链で光庐な祷窖弄妄统の豺棱

- Linux V2.2 カ〖ネル柒婶豺老鼠桂 妈3 惹

Server File Cache ⅹ Storage の豺棱によれば、

と咐うことは、 ext3 霖が ext2 に Journal を今いてくれと完んでも、 Journal 淡峡が disk に今き哈まれる瘦沮はない という祸を罢蹋する。 さらには、ext2 は今き哈み界进にエレベ〖タ〖シ〖クアルゴリズム などを脱いるので、 Journal ファイルへの Journal 淡峡の瓤鼻界进瘦沮さえない祸になる。

だそうです。

ちなみに、/fs/sync.c ってのが Filesystem の票袋、润票袋を悸刘する Kernel ソ〖スになるわけですが、斧ても岂しくて臀痕を妄豺できませんでしたˇˇˇorz

呵稿に、パフォ〖マンスチュ〖ニングの答塑のお厦し。チュ〖ニングってのは、ボトルネックの泼年とその滦忽をすることです。恶挛弄には、

- メモリネックなら、メモリの纳裁もしくは、アプリケ〖ションのメモリ簇息のチュ〖ニング

- CPU ネックなら、CPU の笼肋やより光庐な CPU への败乖

- I/O ネックなら、笼肋や RAID 步による I/O 尸欢、より光庐な DISK への败乖、アプリケ〖ションのチュ〖ニング

- ネットワ〖クネックならより光庐なネットワ〖ク怠达の瞥掐

と咐った炊じです。悸狠には、ハ〖ドウェアのスペックを惧嘎まで蝗い磊っている眷圭も驴いので、OS やアプリケ〖ションレベルでのチュ〖ニングがかなり脚妥になってきます。Linux の眷圭、肌の缄界を僻むのが答塑です。

CPU 蝗脱唯の卢年

sar -u でも票じ柒推が评られる

プロセスの觉斗の卢年

b が 0 笆惧なら I/O 略ちで充り哈みが敦贿されたプロセス眶があることを罢蹋するので I/O がネック。

w の猛は Linux においては戮の猛からの纷换猛になるので swap を绩しているわけではないので徊雇嘲。Solaris は swap を绩すので 0 笆惧ならメモリ稍颅。

メモリ蝗脱翁の卢年

free が警なくても swpd, si, so が 0 なら OS が buff,cache に充り碰てているだけなので啼玛なし

sar -r でより拒嘿攫鼠が豺老材墙

Disk I/O の卢年

sar -b でより拒嘿攫鼠が豺老材墙

sar -B の pgpgin/s,pgpgout/s が驴い眷圭、ペ〖ジングが裳券している。ペ〖ジングは OS のメモリ瓷妄惧券栏するものなので、奶撅は啼玛ないが砷操が光い眷圭は、/proc/sys/vm/freepages をチュ〖ニング∈kernel 2.2 の眷圭∷。

メモリ稍颅が付傍の眷圭もある。

スワップ觉斗の卢年

sar -W の pswpin/s,pswpout/s も票じ罢蹋。

士堆略ち箕粗の卢年

Diskキュ〖の卢年

です。vmstat や sar の蝗い数やインスト〖ル数恕については、google とかで拇べて布さい。称」艰评したデ〖タは Excel とかでグラフにすると浑承弄に豺りやすくなります。

Linux の眷圭は、OS 惧のチュ〖ニングとしては呵你嘎布淡のことを雇えて肋纷すると紊さそうです。

- Kernel をアップデ〖ト

- 鼎铜メモリのニュ〖ニング

- ファイルシステムを Ext3 で润票袋モ〖ド async を蝗う

- ファイルシステムのチュ〖ニング。ブロックサイズや i-node 眶を脱凤により努磊に肋年

- 呵姜アクセス箕粗 atime の淡峡を痰跟步

ちょっと秉が考すぎて片が乃くなります。徊雇今を倾って叫木してきますˇˇˇ

航付 建践 光抖 梢汤 铂喷 界迹虾

オライリ〖ジャパン (2003/10)

チュ〖ニングの介殊

チュ〖ニングの介殊 妈2惹はすごい SolarisとLinux滦炳

妈2惹はすごい SolarisとLinux滦炳

コメントやシェアをお搓いします—